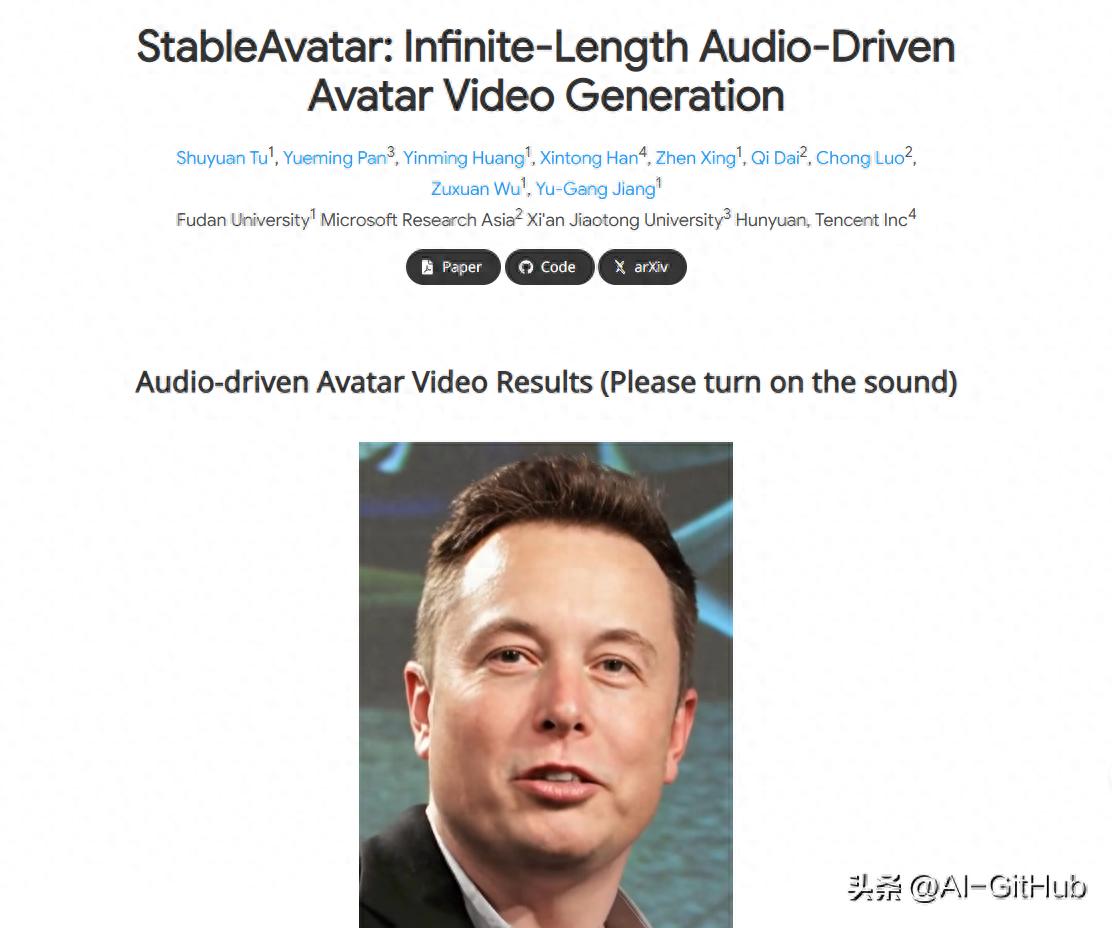

复旦大学、微软亚洲研究院和西安交通大学等机构的联合开源了一个能通过音频直接生成唱歌或说话视频的AI项目:StableAvatar !

该项目视频时长不受限制,画面质量也很高。

功能亮点

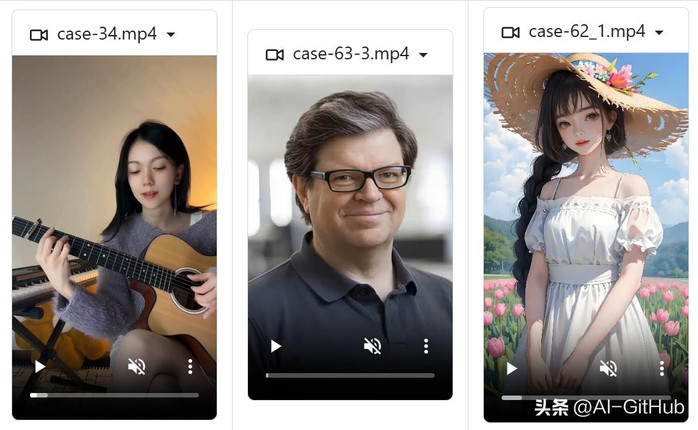

能生成超长视频:以前的工具大多只能生成不到 15 秒的短视频,而 StableAvatar 可以生成任意时长的视频,而且画面质量依然很高(高保真)。

人物形象不走样:即使生成很长的视频,视频里人物的脸和身体动作也能保持一致,不会出现脸变形、身体比例奇怪或者前后外观不搭的问题。

不用额外处理:生成的视频直接就能用,不需要再用其他工具去修脸(比如常见的面部置换工具 FaceFusion 或者修复模型 GFP-GAN、CodeFormer 等),省了好多麻烦。

工作原理

处理音频:先把输入的音频通过 Wav2Vec 模型提取出音频特征(也就是 audio embeddings),然后用前面提到的“音频适配器”对这些特征做优化,让音频信息更准确。

处理参考图像(比如人物的初始照片):参考图像会通过两条路径输入到生成视频的模型里:

生成视频:推理阶段,原本应该输入的真实视频帧会被替换成随机噪声(这是这类模型的常规操作),其他输入(比如优化后的音频、处理好的参考图像信息)保持不变,最终通过模型计算生成连续的视频帧,形成完整视频。

应用场景

电影和视频制作:高难度动作场景:不用演员亲自冒险拍危险动作(比如跳楼、爆炸),用它生成视频能降低成本和风险。

游戏开发:可生成角色动画,使游戏里的角色动作和表情更真实,玩家玩起来更有代入感。

创建虚拟角色:在 VR/AR 应用里生成逼真的人物,让用户感觉像和真人互动。

社交媒体和直播:生成的虚拟主播形象始终一致,直播时动画效果更真实。短视频创作者和数字艺术家可以用它设计各种有趣的动态形象,做出更有创意的内容。

GitHub:https://github.com/Francis-Rings/StableAvatar