Hi ,早上好。

我是洛小山,和你聊聊 AI 思考。

前两天,我发现了一个几乎不可能被 AI 替代的工作:

AI 几乎不可能替代人类做商业运营决策。

周末两天上了沙盘模拟课:模拟企业经营。

玩法很简单,分成五组,各组根据虚拟市场运行规则,决定在哪建厂,生产什么,生产多少,卖多少钱,搞不搞营销,需要卷死其他四个组获胜,优胜团队荣获王者水晶。

当我得知是这样的模拟游戏的时候,内心窃喜。

需求清晰,数据丰富,规则明确,这岂不是天然落在 AI 射程范围内。

用 AI 还不是手拿把掐?

我把想法和团队一说,大家纷纷表示支持,计划让 AI 带我们躺赢。

于是我们胸脯一拍,起名为水晶动力,甚至准备了 Logo,就差没准备获奖感言。

结果,第一天结束时…

怎么说呢… 属实是光屁股拉磨,转圈丢人。

我们股价相当于倒数第二的 80%,第一组利润是我们的 8 倍。

大家纷纷向我们投来关怀的眼神…

好好好,AI 先驱秒变 AI 先烈。

下课之后,我心情久久不能平静。

一直在思考, 我的脸往哪搁 AI 为什么做不好企业经营管理?

熬夜翻了六七篇论文之后,我找到了一些解释,和你一起交流。

一、模型结构和训练方法从根本上决定了它做不好决策

结论:我们前几轮之所以惨败,根源在于大语言模型架构(后文我会称之为 LLM )以及它的训练范式,和企业经营这种复杂的动态任务存在着根本性的冲突。

先介绍下我们的使用步骤:

首先,所有背景材料和盘面的数据,我全部转成结构化的文本,人工校准里面所有的数据,确保输入的信息绝对干净,不存在 LLM 识别图片导致数据的异常。

然后,也是最核心的:我要求 LLM 必须先写代码,再给结论。

整个过程在 Cursor 里完成,AI 先生成代码,分析数据,然后基于计算结果说话。

我当时认为,这套 PAL 流程让 AI 的分析锚定在了可观的数据结果上,几乎杜绝了 AI 胡说八道的可能。

它的每一次输出,都将是纯粹理性的计算结果。

信心满满,一看就很专业!

给你看看过程中的结论。

为保护沙盘游戏版权,部分内容打码。

看起来是不是挺稳,挺牛逼的?

有理由数据,推理严丝合缝,我们小组的成员一开始也是这么认为的。

把我们公司的运转交给了小组第十二名成员:Claude Sonnet 4。

结果大家都知道了,我们的战略上中规中矩,策略上错得离谱。

真的是,寄居蟹搬家,蚌埠住了。

这一问题的根源是:大部分 LLM 在训练过程中缺少针对商业分析为目标的专门优化。

因为:传统商业分析通常需要明确目标(例如利润最大化、风险最小化),需要通过分析数据,然后找到最优解。

但 LLM 的训练目标是:提高文本预测的似然(预测下一个词汇或标记的概率准确性),不一定包括商业分析目标的优化。

这样就会导致 LLM 缺少内置的「目标导向」推理能力。

也就是说, LLM 不但不会在商业分析中主动寻找最优决策,

相反地, LLM 倾向于给出平均意义上的合理回答,

LLM 可能能够同时罗列多方面考虑,但它不具备始终一致的决策准则(或者说是符合经济学、管理学的逻辑)来选择最优方案。

接下来,LLM生成文本的时候,没有可靠的面向结果确认机制。

常规的机制下,只要 LLM 在输出在形式上符合语言逻辑,那就算完成对话任务,哪怕这里面有多少逻辑矛盾,或者非常离谱的战略。

因为 LLM 在用户没有指出的时候,没办法直接纠错。

进一步地,商业决策还需要涉及多个环节的层层推理,简单来说,就是从一个数据进行跳跃式的思考,结合各种因素层层递推,如果发现异常,还要从脑子里拿掉这个过程。

抽象来说,至少会先假设一个情景,然后分析方案,对比优劣势,进行抉择。

但 LLM 只会考虑平铺直叙的回答。

这在复杂商业分析中是致命弱点。

另:LLM 的讨好性对话策略,会丢失自己的判断,遵循你的思路,哪怕你的思路多么离谱,它都会试着将你的策略合理化。

这在经营管理中,应该是非常要命的了…

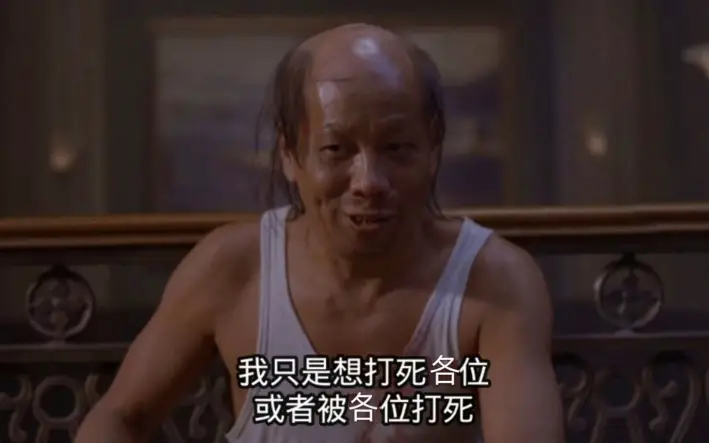

这不就是当代王振吗?明朝朱祁镇已经吃过这样的亏了,不能太过于相信这种巧言令色的人~

简单来说,只要你对大模型的方案提出了挑战,大部分情况下,大模型就放弃了自己的立场。

而作为人类 CEO,你极有可能会和 CFO 或者战略的人吵起来,然后互相觉得对方是傻 X。

在我们提出挑战之前,我们在没有经过仔细研读数据时,我们都认为「大模型的这个战略还挺合理的。」

大模型具有迷惑性的答案(一本正经地胡说八道),是我们前期让渡了团队思考导致翻车的根本原因。

本段内容参考论文:

https://arxiv.org/abs/2502.11574

二、即便拥有一切需要数据的情况下,LLM 仍不能进行复杂决策与战略

说实话,我们几乎将一切能给的数据都灌输给 LLM 了。

但,它作出的策略,没有办法带领我们取得胜利。

因为:它给出的是中规中矩的策略,而我们的对手们,是行业里面的卷王。

如果你周围全是小白,LLM 能帮你拉到 70 分糊弄过去的水准,然后你能鹤立鸡群;

但如果你周围全是大佬,全是卷王,大家追求的是无限接近 100 分,你还拿这样的结果出来,LLM 会让你成为市场中的笑柄。

为什么?

商业战略制定是需要对一些特定情境有深刻理解、创造性思考和对人性的判断。

但 LLM 输出的战略规划往往套路化,很难明确识别在这个情境下面的关键挑战、竞争定位和获取优势的方法,他们对人性缺少真正了解,所以很难做好对各个选项的权衡。

也就是说:大模型极其容易生成听起来合理但千篇一律的方案,LLM 不但没办法像刘润那样针对独特情境提出创新性的解决思路。有时还会给出自相矛盾的建议,或者在不同回答中对同一方案的评价不一致。

暴露的问题是:LLM 缺乏稳定的决策准则。

如果把决策交给大模型做,那么大模型大概率会把你带到沟里。

假设你非要把所有的数据,周围的环境,人际关系,竞争格局等等数据灌给大模型,让大模型做决策,

先不说大模型没办法拿捏好国内的人情世故,

更严重的短板:LLM 不但受到上下文窗口长度的影响,对于市场变化而言,上下文是静态切片!

本段资料:

https://arxiv.org/abs/2502.11574

https://www.kevinjruth.com/blog/library/governance/ai-fails-to-understand-strategy

三、就算有上下文,上下文都只是瞬间发生的快照

这个决定了,大模型和人类的关键区别。

人类能适应混沌状态,人类能凭借经验或者所谓的「第六感」,捕获到蝴蝶山东的翅膀。

人类能卧薪尝胆,坚持很长时间,从一点点小事开始布局,在未来 N 年才形成完整的「打法」或者「战略」。

在市场厮杀下,某一次激烈的价格战,负面影响深远地可能会持续十几年。

这…

大模型推不出来,就算能推出来,大模型也没那么长的上下文。

就算有这么长的上下文,前文的内容还会干扰大模型后续的推理。

毕竟,它只是一个 Token 推 Token 的无情机器人罢了。

本段内容参考论文:

https://arxiv.org/pdf/2505.10543

四、逆风翻盘的反思

上面我们讲了这么多 AI 不行的原因,那么难道 AI 在我们的决策中,完全帮不上忙吗?

非也!!

我们从第一天的倒数第一,到第二天凭借 AI 协同逆风翻盘。

连超三组,最后输给了冠军,虽败犹荣。

发生了什么?

一、稳住心态;

二、找到 AI 擅长领域。

说实话,这一次经营模拟课程里,我发现有许多人仍视 AI 为洪水猛兽,或者轻视 AI 的能力。

第二天,我也受到其他组的打趣:

「你们继续用 AI 搞嘛!」

「你看 AI 有啥用,用 AI 搞到垫底。」

过程中老师直言,「你们不是第一个用 AI 的,但借助 AI 无一例外,都是垫底。」

但越是到这个时候,越是要稳住,毕竟还有一天要打。

那时,我心里目标是:只要不垫底就行。

经过反思之后,我转换了思路。

AI 虽然做不好决策,但! AI 很擅长写代码!

那就让 AI 做好 Dashboard , 把所有数据都整理出来,给人类做决策!

其他组需要拉 Excel ,需要手算的内容,我们借助 AI 一键可视化。

秒解决战斗。

从拿到每一回合数据,到给出全部数据报表,只需五分钟。

如果没有数据可视化,需要花时间手算…

我们能快速查看整个市场趋势,不需要手算,想要哪个数值直接点。

想算趋势,直接看。

想看所有组所有产品的市场定价和份额,直接看。

想看所有组的产品能力,直接看!

快速预估合理的研发费用

于是,第二天绝地翻盘,结束时排在第二。

终于还是保住了颜面…

虽然两天花了 40 刀…

虽然在过程中我疯狂怀疑自己是不是有问题…

你可能会觉得我内心戏太多了,哈哈。

但经历了第一天全面劣势,基本快崩盘的情况下,能稳住就是胜利。

更别说我们超越了…

作为组里唯一一个坚定支持我用 AI 的队友,也是我们的班长,结束的时候给我转了超大的红包!

不过没好意思领…

毕竟,他也是坚定的 AI 落地践行者

但好在,我们组收获可能是最大的,大家切身感受到:

无条件信任 AI ;

PTSD 放弃 AI ;

接受 AI 与 AI 协作。

属实是亲历了达克效应了…

结论大概是:AI 不弱,弱的是我们,是我们没有摸到 AI 的能力边界;

毕竟,我们按牛头喝水,被牛踹两脚也合理吧…

两天的课结束了,我最大的收获…就是意难平。

现在也很气,为什么我早没有用它来干数据可视化!!

可恶!!

但是,

商业世界,没有那么多早知道,

不是吗?

我是洛小山,关注我,咱们下一篇文章见~

文章来自于微信公众号“洛小山”,作者是“洛小山”。